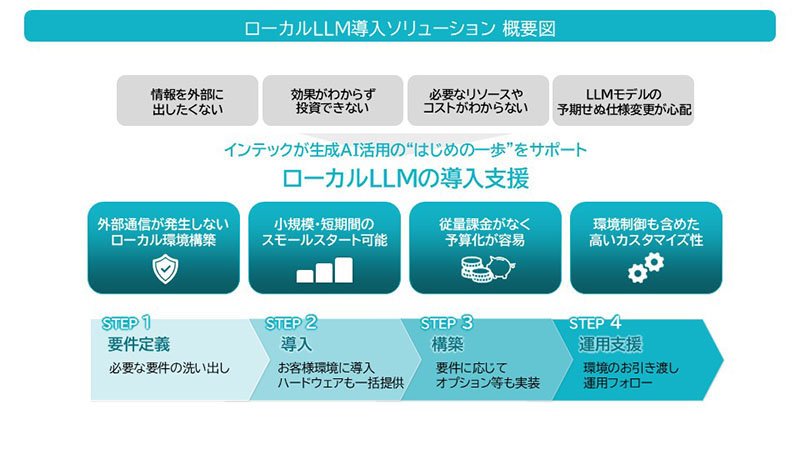

ローカルLLMの導入支援

こんなお悩みありませんか?

- 法令や社内のセキュリティポリシー等の制約で生成AIの活用を躊躇している

- 生成AIのノウハウがなく、導入のハードルが高い

- 生成AIの導入効果がわからず、思い切った投資ができない

- 自社の環境や業務にあわせて生成AIを効果的に活用したい

その悩みインテックが解決します

安心のローカル環境での構築

外部と通信することなく回答を生成するため、生成AI活用における機密情報や個人情報を保護することができ、情報漏洩リスクを極限まで低減できます。

導入だけでなく、導入後のサポートもおまかせください

インテックが長年培ってきた豊富なインフラ構築実績や自社サービス運用のノウハウを活かし、ローカルLLMの導入時だけでなく、導入後のサポートも実施します。

小規模PoCでスモールスタートが可能

導入規模を限定したPoC環境を構築できるので、本格導入前にリスクを最低限に抑えて検証できます。

お客様の環境に合わせてカスタマイズ可能

クラウドLLMでは困難な、モデルや環境バージョンのユーザー制御が可能で、業務プロセスやデータ環境に合わせて柔軟にカスタマイズできます。

概要

生成AIの導入や活用を検討している企業に向けて、オンプレミスや閉域ネットワーク内で稼働可能なローカルLLM環境を提供します。

外部のクラウドサービスを介さずにAIを活用できるため、機密情報の保護と高い安全性を確保できます。また、小規模から導入できるため、生成AI活用拡大へ向けての合意形成を進めることができます。

特長

クラウドを介さないローカル環境構築

一般的なクラウドLLMを業務に適用する場合、クラウド上に社内情報を連携・保管する必要がある一方、ローカルLLMでは、自社環境内に保管された情報を参照し、外部と通信することなく回答を生成することが可能です。これにより、企業は生成AI活用における機密情報や個人情報を保護することができ、情報漏洩リスクを極限まで低減できます。さらに、幅広い領域における 豊富なインフラ構築経験を持つインテックのSIスタッフが、企業の環境に最適な構築・運用をトータルサポートすることで、高いセキュリティレベルを維持した生成AI活用が実現できます。

小規模PoCでスモールスタート可能

導入規模を限定した短期間で構築できるPoC環境を提供し、リスクを最小限に抑えたスモールスタートが可能です。企業要件や現場環境に応じた柔軟な環境調整が行えるため、実業務を通した活用効果の検証にフォーカスし、本格導入前の精度の高い意思決定を後押しします。

クラウドLLMのような利用頻度やデータ量増加に伴う従量課金が発生する利用モデルではないため、予算策定や経営判断における不安を解消し、効果検証後は、GPUサーバの増設や処理能力の拡張、データセンターやネットワークを含めたインフラ全体の設計・構築へと段階的に拡張することが可能です。

インフラ基盤をワンストップで提供することで、企業の生成AI活用フェーズに合わせた持続的な価値創出に貢献します。

カスタマイズ性の高い環境をワンストップで導入

LLMモデル本体の提供に加え、ローコードワークフローツールやRAG機能※1など、プログラム開発の知識がない担当者でも簡単に設定できる環境を導入します。

クラウドLLMでは困難なモデルや環境バージョンのユーザー制御が可能で、業務プロセスやデータ環境に合わせた柔軟なカスタマイズと多様なユースケースに対応します。

- ※1RAG機能:大規模言語モデル(LLM)によるテキスト生成に、社内情報等への検索を組み合わせることで、解答の精度を向上させる技術

商品・サービスに関するお問い合わせ

Webから問い合わせる